Данные - это новое масло, верно? Но в отличие от нефти для ее добычи не нужны буровые установки. Вам нужны краулеры или скребки.

В этом обзоре мы рассмотрим Робот-скребок - инструмент веб-парсера - мы узнаем, как он работает и какую пользу вы можете получить от него.

Scraping Robot обещает, что вы сможете сэкономить время и реализовать значимые возможности для работы, потому что вам не придется час за часом собирать данные вручную из профилей социальных сетей, источников электронной коммерции, веб-сайтов, досок объявлений и других.

Вы можете использовать собранные данные, чтобы получить более четкое представление о своем бизнесе, лучше исследовать рынок и опередить своих конкурентов, которые не скрапируют.

Что такое парсинг в Интернете, как он работает и как вы его используете с этической точки зрения?

Давайте исследуем ответы.

Что такое веб-скрапинг?

Когда вы копируете данные с веб-сайта в электронную таблицу, базу данных или другое центральное место для последующего извлечения, вы очищаете Интернет. Но выполнение этого вручную может занять много времени, поэтому мы привыкли доверять программным решениям, которые помогают нам выполнять работу.

Вы можете автоматизировать этот процесс сбора данных с помощью веб-сканеров. Веб-скрапинг также называется сбором веб-данных или извлечением веб-данных.

Очистка веб-страниц может выполняться с помощью любого из этих восьми методов:

- Анализ объектной модели документа (DOM)

- Разбор HTML

- Копирование и вставка человека

- Вертикальная агрегация

- Соответствие текстового шаблона

- Распознавание семантической аннотации

- Компьютерное зрение анализ веб-страниц

- HTTP программирование

Мы не будем вдаваться в подробности каждого процесса. Просто знайте, что вы можете собирать данные с веб-сайтов разными способами.

8 навыков этичных веб-скребков

Самый большой аргумент против парсинга - его этичность. Как и все, что дает нам рычаги воздействия - деньги и Интернет, например, - этим воспользуются злоумышленники.

Если вы используете этичный парсинг, это хорошо. Все сводится к вашим моральным стандартам.

Как этичные люди используют парсинг веб-страниц?

1. Соблюдайте стандарт исключения роботов

Стандарт исключения роботов или файл robots.txt показывает поисковому роботу, где он может сканировать или не сканировать веб-сайт.

Это протокол исключения роботов, REP, который регулирует доступ сканеров к сайту.

Не игнорируйте правила файла robots.txt при сканировании сайта.

2. Сделайте приоритетным использование API.

Если на веб-сайте есть API, поэтому вам не нужно очищать его данные, используйте API. Когда вы используете API, вы должны следовать правилам владельца сайта.

3. Уважайте Условия использования других людей.

Если на веб-сайте есть политика добросовестного использования или условия доступа к своим данным, соблюдайте их. Они открыто говорят о том, чего хотят, не игнорируйте их.

4. Скребок в непиковые часы.

Не истощайте ресурсы сайта, размещая запросы, когда он занят. Помимо финансовых последствий, вы можете послать владельцу сайта ложный сигнал о том, что сайт подвергается DDoS-атаке.

5. Добавьте строку User-Agent.

При парсинге сайта подумайте о добавлении строки агента пользователя, чтобы идентифицировать себя и упростить для них связь с вами. Когда администратор сайта замечает необычный всплеск трафика, он точно знает, что происходит.

6. Сначала ищите разрешения

Запрос разрешения - это шаг впереди строки пользовательского агента. Спросите данные еще до того, как начнете их списывать. Сообщите владельцу, что вы собираетесь использовать скребок для доступа к его данным.

7. Тщательно обращайтесь с контентом и уважайте данные.

Будьте честны с использованием данных. Берите только те данные, которые вы хотите использовать, и очищайте сайт только тогда, когда они вам нужны. Когда вы получили доступ к данным, не делитесь ими с другими людьми, если у вас нет разрешения владельца.

8. По возможности предоставляйте кредиты

Поддержите сайт, поделившись их контентом в социальных сетях, отдавая им должное, когда вы используете их работу или делаете что-то, чтобы привлечь людей на сайт в знак признательности.

Начиная со скребкового робота

Чего ожидать от робота-скребка?

Я познакомлю вас с этим программным обеспечением, шаг за шагом.

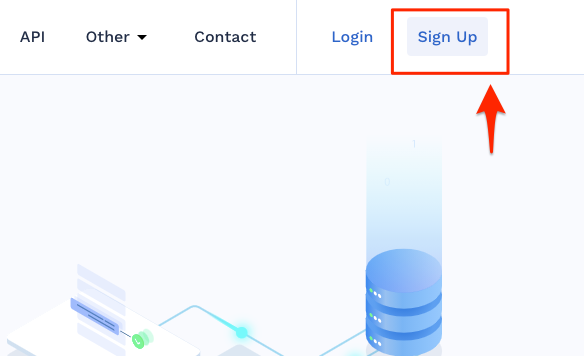

Естественно, первым делом я зарегистрировал бесплатную учетную запись Scraping Robot. Итак, я нажал «Зарегистрироваться», чтобы начать процесс.

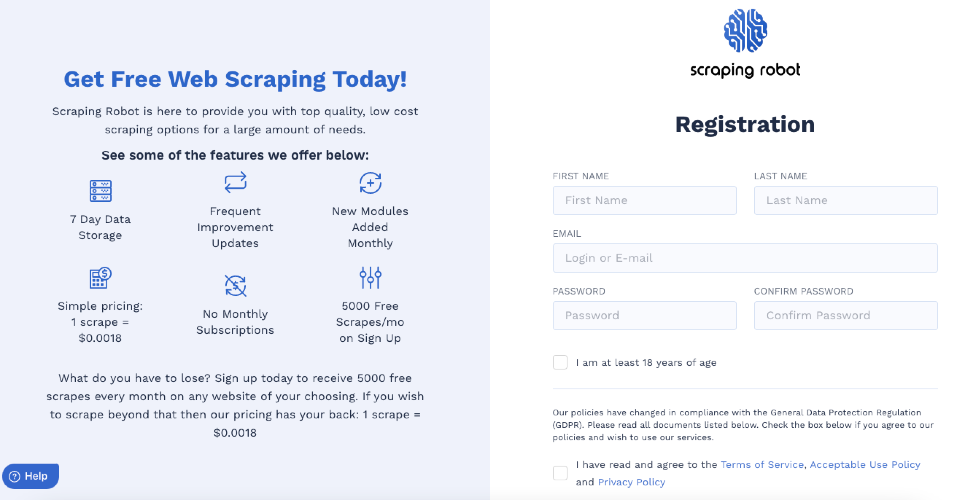

Я заполнил следующую форму.

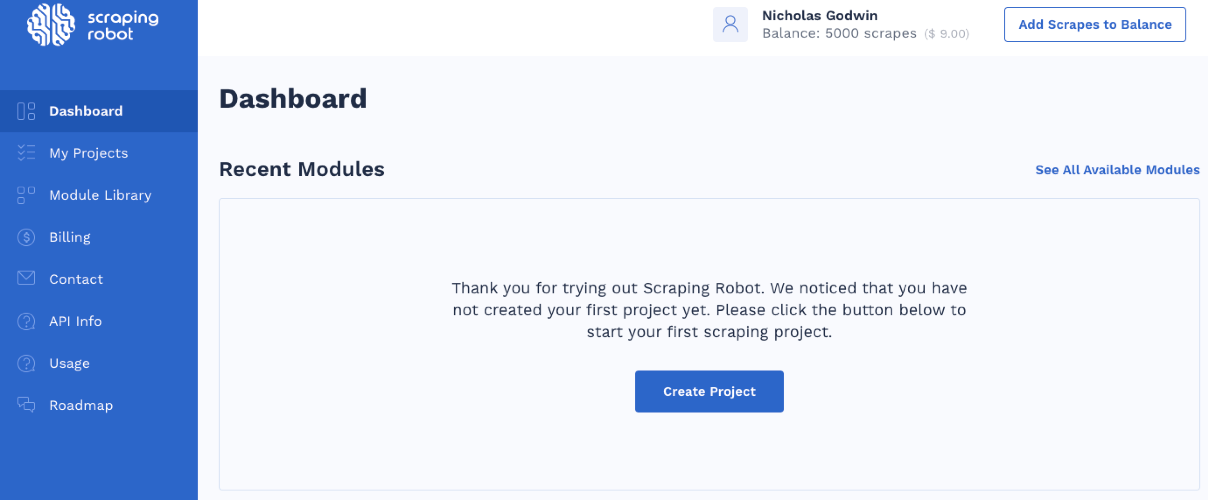

Это приводит меня к панели инструментов, где я могу начать использовать скребок.

Если вы нажмете синюю кнопку «Создать проект» или выберите «Библиотека модулей» в боковом меню, вы попадете на одну и ту же страницу.

Как работает робот-скребок

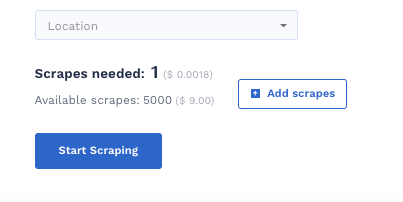

Scraping Robot предлагает пользователям 5000 бесплатных сборок каждый месяц. Этого достаточно, если набор данных, который вы ищете, невелик, но если вам нужно больше царапин, вы платите 0.0018 доллара за каждый цикл.

Вот процесс робота-скребка.

Шаг №1: разместите запрос на очистку

Выберите модуль, который соответствует вашему запросу, введите запрос данных. Затем Scraping Robot будет использовать эту информацию для запуска процесса скрапинга.

Шаг № 2: Робот-скребок получает доступ к безупречной SEO

Blazing SEO и Scraping Robot объединились, чтобы предоставить прокси, которые обрабатывают каждый ваш запрос на парсинг. Неиспользуемые прокси-серверы поступают от Blazing SEO, в то время как программное обеспечение Scraping Robot обрабатывает их.

Шаг № 3: запустите запрос на очистку

Робот-очиститель выполнит ваш запрос с максимально возможным количеством неиспользуемых прокси от Blazing SEO. Робот-очиститель делает это, чтобы выполнить ваш запрос в кратчайшие сроки. Цель здесь - выполнить ваш запрос как можно быстрее и эффективнее, чтобы вы могли просмотреть свои результаты и инициировать новые запросы.

Шаг # 4: заплатите за очистку

Партнерство, которое установил Scraping Robot с Blazing SEO, позволяет им предлагать свои услуги очистки по невысокой цене.

Шаг № 5: Гарантия на робота-скребка

Хотя Scraping Robot предлагает «Гарантию» и обещает круглосуточную доступность для решения любых проблем, связанных с их продуктом, он не дал никаких конкретных гарантий. Неясно, получите ли вы гарантию возврата денег или нет.

Готовые модули

Scraping Robot предоставляет готовые модули, позволяющие легко и недорого очищать различные веб-сайты. Скребок имеет 15 готовых модулей. Давайте исследуем каждую из них.

Модули Google

В парсере есть два встроенных модуля Google:

- Скребок Google Адресов

- Google Парсер

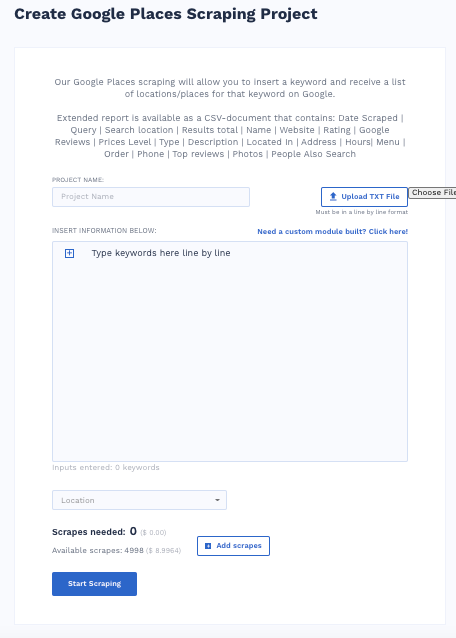

Чтобы использовать парсер Google Адресов, выполните следующие действия.

- Назовите свой проект парсинга

- Введите ключевое слово и местоположение

Например, я ввел ключевое слово «Аренда Калгари» в поле ключевого слова.

А затем я вошел в меню локаций Калгари, Альберта, Канада. Вы найдете меню чуть ниже поля ключевых слов.

Я нажал синюю кнопку «Начать очистку», чтобы начать очистку.

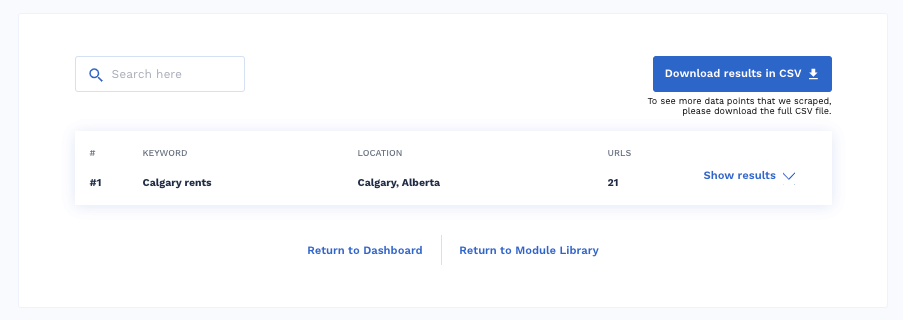

Через несколько секунд появились мои результаты.

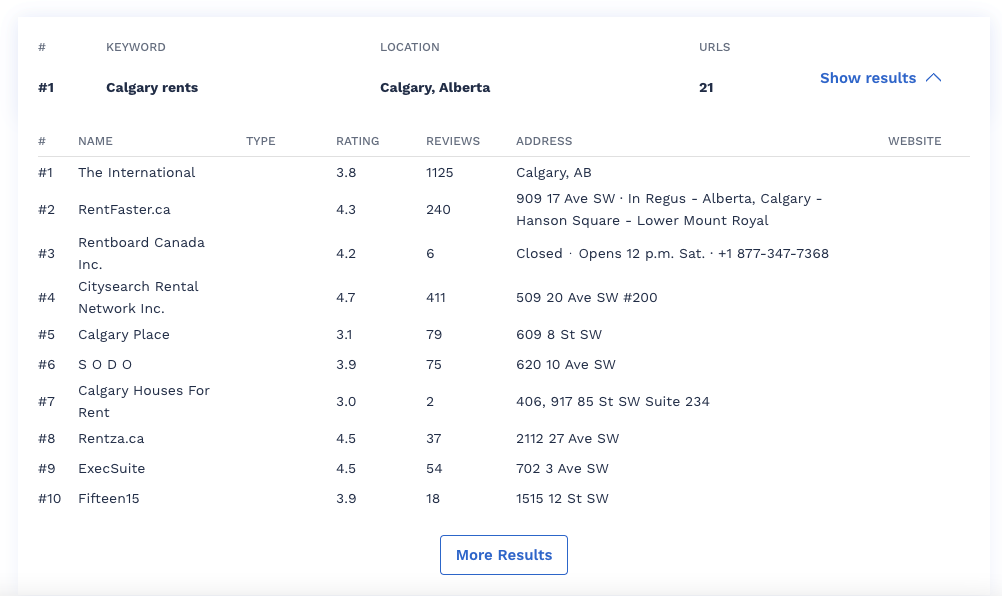

Когда я нажимаю «Показать результаты», я вижу полные результаты.

Остальные результаты я увижу, щелкнув «Дополнительные результаты». Когда я загрузил CSV, я получил исчерпывающий отчет, содержащий больше данных, чем я видел на панели инструментов. Дополнительные данные включают адреса, часы работы, номер телефона, количество отзывов в Google и рейтинги.

Всего я получил 20 отчетов о местах, которые ранжируются по этому ключевому слову.

Для модуля Google Scraper вы получите 100 лучших URL-адресов от Google по определенному ключевому слову. Этот процесс выполняется так же, как и в Google Places Scraper.

Плохой сюрприз здесь заключается в том, что Scraping Robot не перечислил веб-сайты тех мест, которые он извлек из Google Place Scraper.

Модули Indeed

В модуле Indeed есть три подмодуля.

- Действительно Джоб Скребок

- Компания Indeed Отзывы Scraper

- Действительно Зарплатный Скребок

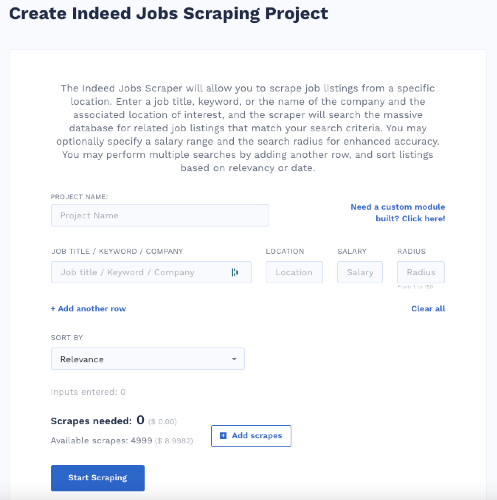

Инструмент Job Scraper позволяет собирать списки вакансий из определенного места на основе ключевого слова или названия компании.

Подмодуль обзора компании позволяет извлекать и экспортировать обзоры, рейтинги и другие оценки компании. Назовите свой проект и введите название компании, чтобы сканировать все необходимые данные. Вы можете найти данные о зарплате, заполнив форму на странице сбора данных о зарплате.

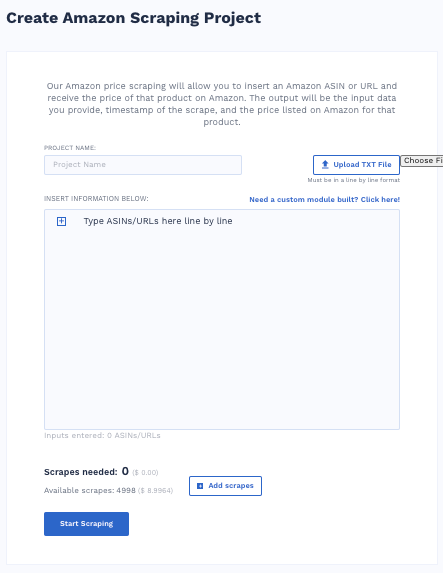

Amazon Скребок

Модуль Amazon scraper позволяет вам получать данные о ценах, вводя ASIN или URL-адрес продукта Amazon, а затем получать данные о ценах на этот продукт Amazon.

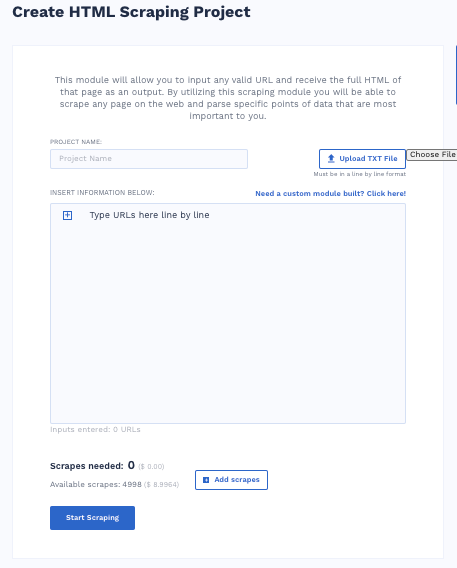

HTML-скребок

Модуль HTML-скребка позволяет вам получить полные HTML-данные любой страницы, если вы введете действительный URL-адрес страницы. Этот парсер позволяет извлекать любые данные из Интернета для хранения или анализировать их на предмет конкретных точек данных, которые важны для вас.

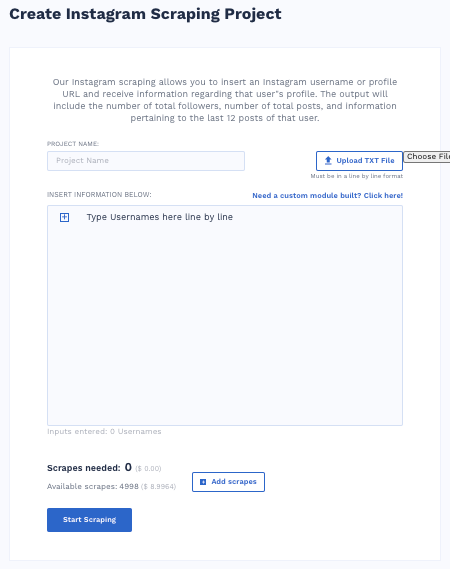

Скребок для Instagram

Модуль Instagram scraper позволяет использовать любое имя пользователя Instagram или URL любого профиля для вызова данных пользователя. Вы получите общее количество постов пользователей, общее количество подписчиков пользователя и подробную информацию о последних 12 постах.

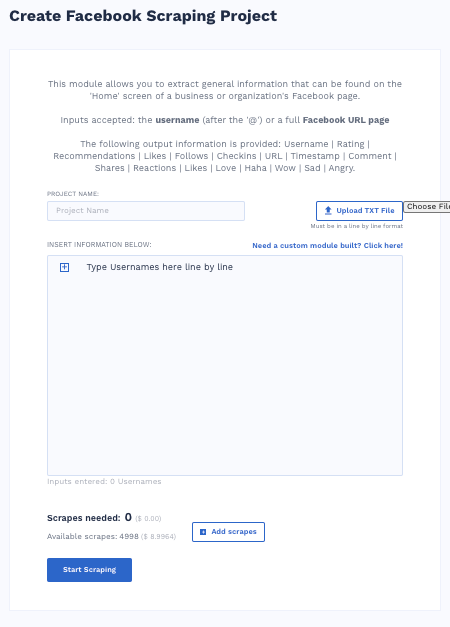

Скребок Facebook

Модуль сбора данных Facebook помогает собирать общедоступную информацию об организации на основе данных с ее страницы Facebook.

Вы можете очистить эти данные, используя их имя пользователя или полный URL-адрес страницы Facebook.

Робот-скребок предоставит вам:

- Имя пользователя

- Рейтинг

- СОВЕТЫ

- Лайк

- Соблюдает

- Отметки

- URL

- Timestamp

- КОММЕНТАРИЙ

- Акции

- Реакции

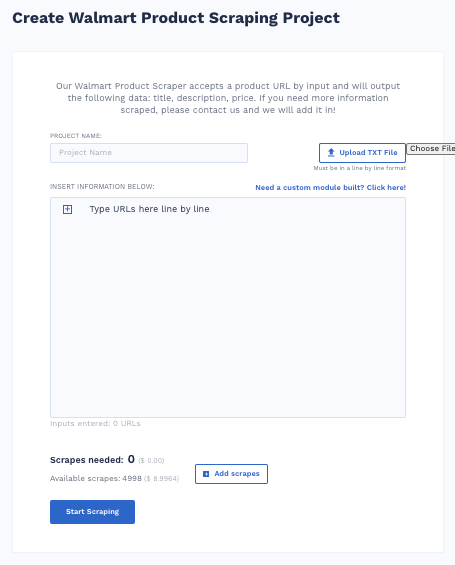

Скребок продуктов Walmart

Вы можете использовать Walmart Product Scraper для сбора данных об описаниях, названиях и ценах продуктов. Введите URL-адрес Walmart, чтобы получить нужные данные.

Робот-очиститель просит связаться с ними, если вам нужно очистить дополнительные данные, и они добавят их.

Скребок для продуктов Aliexpress

Скребок продуктов AliExpress, как и модуль Walmart, помогает пользователям собирать данные о цене, названии и описании, вводя URL-адрес продукта. Пользователи могут отправить собственный запрос к роботу-очистителю, чтобы очистить больше точек данных.

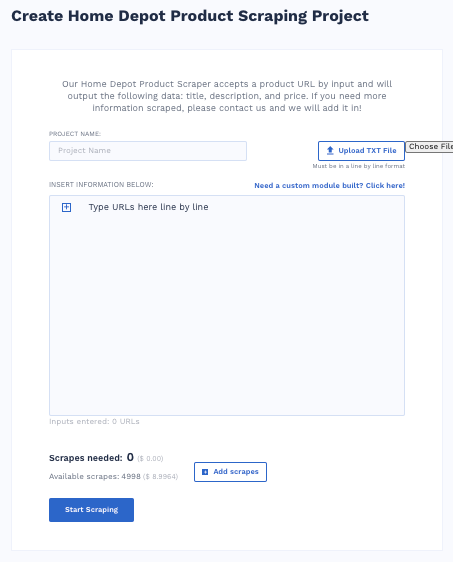

Скребок для продуктов Home Depot

Наш Home Depot Product Scraper принимает URL продукта по вводу и выводит следующие данные: название, описание и цену. Если вам нужно получить больше информации, свяжитесь с нами, и мы добавим ее!

Больше готовых модулей

Scraping Robot имеет множество готовых модулей, которые очищают аналогичные выходные данные. Каждый модуль предоставляет пользователям данные о названии, цене и описании. Другие, не ориентированные на электронную коммерцию, предоставляют пользователям данные профиля.

- Скребок продуктов eBay

- Скребок для продуктов Wayfair

- Twitter Профильный скребок

- Скребок Yellowpages

- Скребок компании Crunchbase

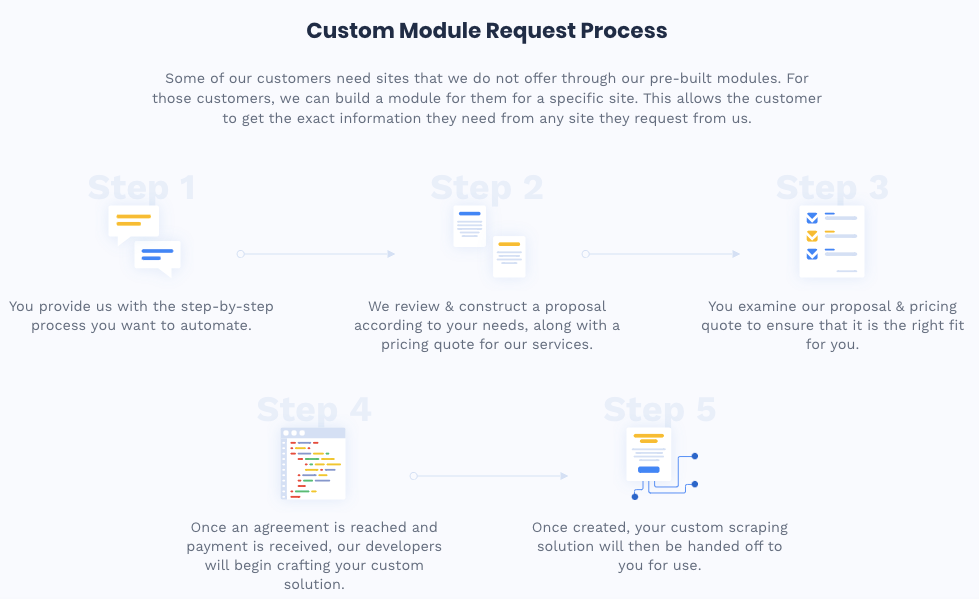

Пользовательский запрос модуля

Эта опция доступна по запросу. При нажатии он переходит на страницу «Связаться с нами». Вы можете связаться с роботом-скребком, чтобы получить индивидуальное решение для очистки.

Вот пятиэтапный процесс получения пользовательских модулей от Scraping Robot.

Шаг #1: Предложите им процесс, который хотите автоматизировать, и пошагово разбейте его на части.

Шаг #2: Робот-очиститель разработает предложение на основе вашего запроса и предоставит вам оценку стоимости услуги.

Шаг #3: Вы одобряете или не одобряете предложение и цитату.

Шаг #4: Если вы одобрите предложение, вы заплатите и заключите соглашение с Scraping Robot.

Шаг #5: Вы получите собственное программное обеспечение для очистки, когда робот-очиститель завершит разработку.

Дополнительные возможности и функции робота-скребка

Робот-очиститель предлагает больше возможностей, чем просто готовые модули. Давайте изучим их.

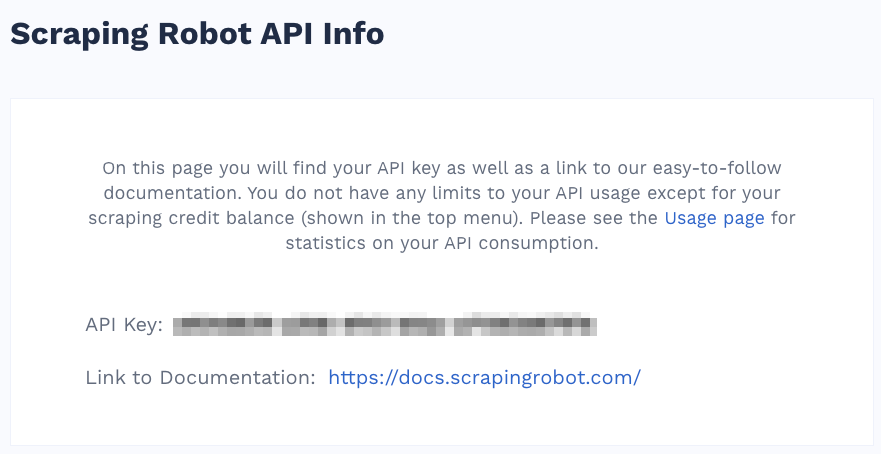

API

API-интерфейс Scraping Robot предоставляет пользователям доступ к данным в любом масштабе на уровне разработчика. Это должно уменьшить беспокойство и головную боль, связанные с управлением серверами, прокси-серверами и ресурсами разработчика.

В своей учетной записи Scraping Robot вы можете найти свой ключ API и страницу документации API. Помимо кредитных лимитов, у вас нет ограничений на использование API.

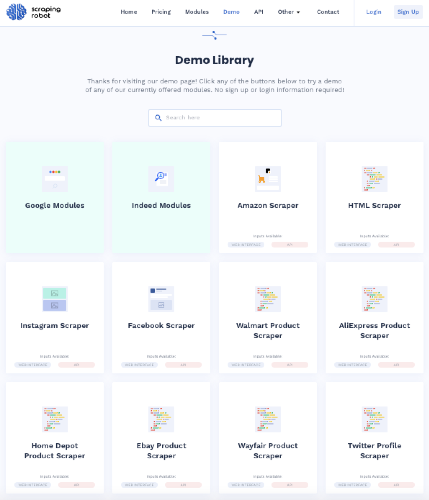

Библиотека демонстраций

Библиотека демонстраций показывает, как работает каждый модуль. Так что, если вы думаете посмотреть, как это работает, эта библиотека - отличное место для тестирования программного обеспечения.

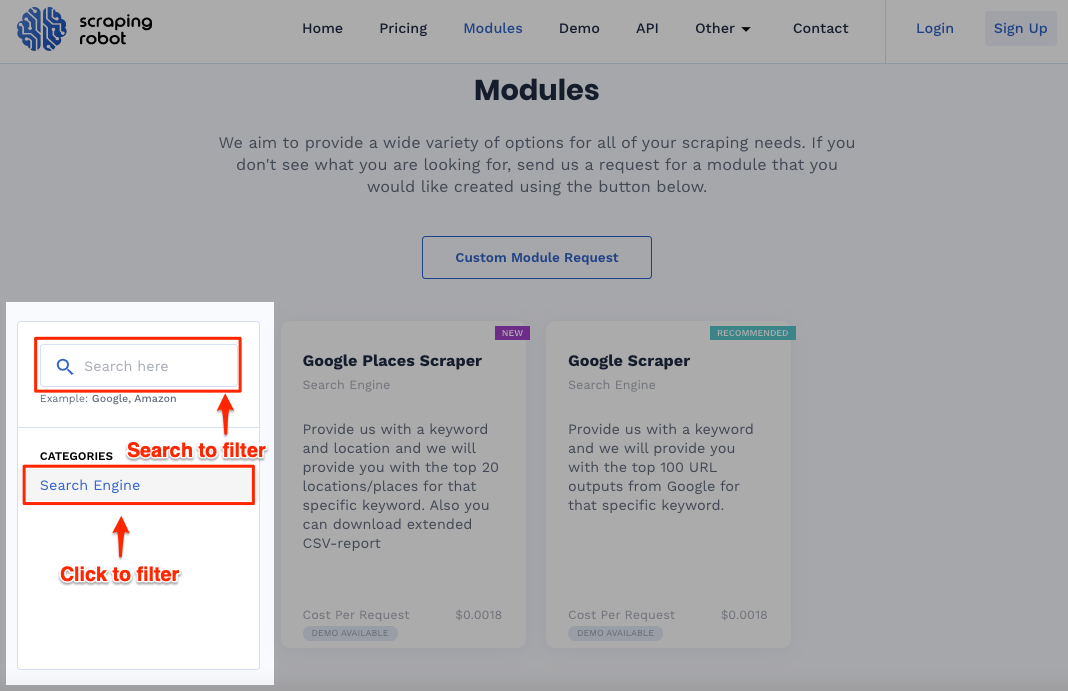

Модуль Фильтр

Фильтр модуля кажется функцией, находящейся в разработке, потому что функция фильтрации по щелчку имеет только фильтр поисковой системы на момент этого обзора. Так что в будущем мы можем ожидать фильтры профилей, фильтры продуктов и другие фильтры.

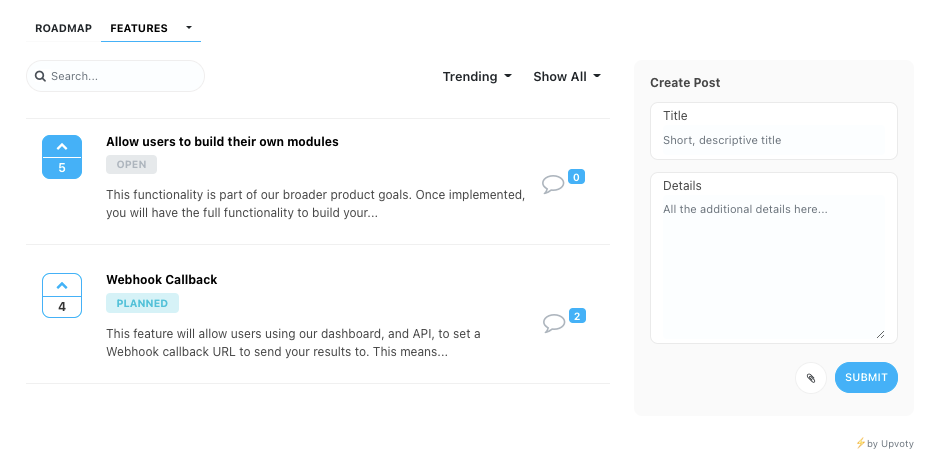

Roadmap

Roadmap позволяет пользователям видеть функции, которые Scraping Robot планирует запустить в будущем или которые предложили пользователи. Эти функции делятся на Planned, In Progress и Live.

Пользователи могут предлагать и голосовать за функции, которые они хотят видеть в Scraping Robot.

Кроме того, на странице цен вы обнаружите, что робот-скребок обещает продолжать добавлять новые модули.

Цены

Он предлагает 5,000 бесплатных очисток в месяц, чтобы удовлетворить потребности большинства людей на этом уровне. Если вам нужно больше соскобов, это будет стоить всего 0.0018 доллара США за каждое взятие.

Scraping Robot говорит, что они могут предложить такую низкую цену из-за партнерства с провайдером прокси премиум-класса. Пылающий SEO.

Контакты

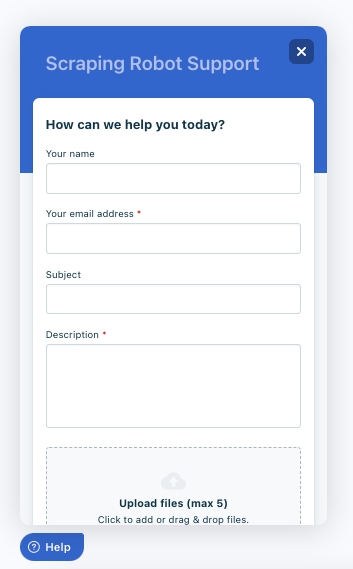

Хотя все, что вы увидите на странице контактов Scraping Robots, - это адрес электронной почты, вы можете использовать их контактную форму для отправки сообщения.

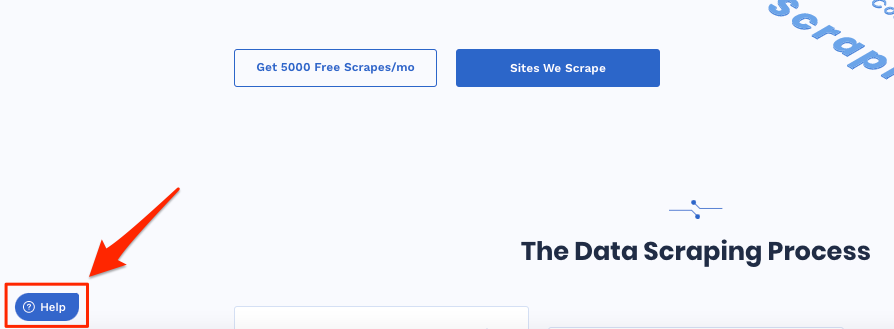

В углу большинства страниц вы найдете плавающий виджет справки.

Щелкните этот виджет, чтобы открыть форму. А затем заполните форму, чтобы отправить свое сообщение.

Удачного соскабливания - Заключение

Мы ежедневно генерируем огромное количество данных. IBM оценивает это 2.5 квинтиллиона данных каждый день или в одном вычислении, 2.5 миллиона терабайт.

Да, данных более чем достаточно, чтобы помочь вам принимать более обоснованные решения для бизнеса и роста.

Если вы хотите собирать данные и создавать аналитические данные для своей организации, Scraping Robot выглядит жизнеспособным решением без дополнительных затрат.

5,000 бесплатных скребковых единиц делают работу без риска. Вы начинаете соскабливать, чтобы помочь вам проверить экономическое обоснование использования инструмента, прежде чем принимать какие-либо финансовые обязательства в отношении этой технологии.

Конечно, вы не хотите ввязываться в юридические вопросы или оскорблять других людей. Обязательно применяйте самые этические стандарты в своей практике соскабливания.

Комментарии Ответы 0